آیا میتوان به روباتها اخلاق آموخت؟

اغلب ما فکر میکنیم که عصر روباتها موضوع داستانها علمی-تخیلی است و بحث اخلاق روباتی موضوعی مربوط به آینده دور، اما زمانی که واقعا با این مسائل روبرو باشیم بسرعت فرا میرسد؛ زمانی که تصمیمها را روباتها میگیرند. سوال این است که روباتها باید این تصمیمها را بر مبنای اخلاقیات بگیرند و اینکه آیا میتوانیم اخلاق را به روباتها آموزش دهیم؟

ماشین طبق برنامه سر ساعت هشت صبح جلوی در خانه میرسد تا شما را به سر کار ببرد. شما سوار میشوید و در صندلی عقب مینشینید و ابزار الکترونیک خود را از کیف درمیآورید تا نگاهی به اخبار بیندازید. تا به حال مشکلی در مسیر خانه تا محل کار پیش نیامده و معمولا ترافیک سبک است. اما امروز اتفاقی غیرعادی و وحشتناک میافتد، دو بچه که با هم گلاویز شدهاند درست جلوی ماشین شما ناگهان وارد خیابان میشوند. فرصت ترمز کردن نیست یا باید به دو بچه بزنید یا بسرعت فرمان را به راست بچرخانید تا از کنار آنها رد شوید اما در این صورت به دوچرخهای که از روبرو میآید برخورد میکنید.

هر دو احتمال بد هستند، اما کدام کمتر بد است؟

پیش از جواب دادن به این سوال یک چیز دیگر را باید بدانید، سال ۲۰۲۷ است و ماشین شما بدون راننده و خودکار است.

در ماشین کنار دکتر ایمی ریمر نشستهام و او پشت فرمان است.

ایمی دکمهای را روی صفحهای فشار می دهد و بدون اینکه به هیچ چیز دیگر دست بزند، ماشین به نرمی راه میافتد، راهنما میزند، پشت چراغ قرمز میایستد، یک پیچ تند را رد میکند، دور میدان میگردد و بعد به آرامی در کناری پارک میکند.

پنج دقیقه اول شدیدا نگران کننده است، اما بعد یکنواخت و کسالتبار میشود. ایمی که دانشجوی دکترا در دانشگاه کمبریج است، سرمهندس خودروهای خودکار جگوار لندرور است. او مسئول این است که این خودرو چه چیزهایی را ببنید و چه واکنشی به آن نشان دهد.

ایمی معتقد است که این ماشین یا ماشینی مشابه آن تا ده سال دیگر در خیابانها تردد خواهند کرد. البته باید مشکلات فنی زیادی مرتفع شوند، اما یک مشکل هست که حتی ممکن است حضور این خودروها را در خیابانها به تعویق بیندازد، مشکلی که نه الکترونیکی است نه مکانیکی: مسئله اخلاق.

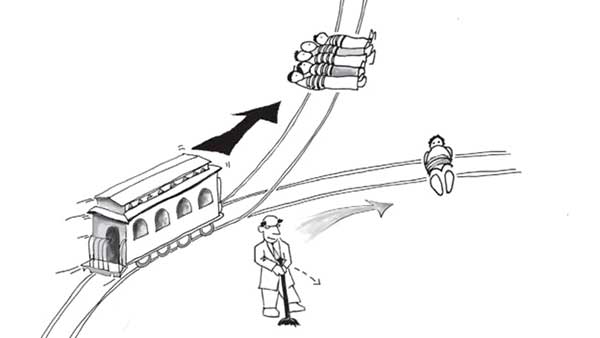

مسئلهای که در مثال دو کودک مطرح شد یکی از اشکال مسئله معروف به “مسئله قطار” در فلسفه است. ترمز یک قطار (یا تراموای) در حال حرکت میبرد. فاجعهای در پیش است چون پنج نفر به ریلهای قطار بسته شدهاند. اگر کاری نکنید همگی میمیرند. کاری که میتوانید بکنید این است که ریل عوض کنید و جان پنج نفر را نجات دهید. مسئله اینجا است که در مسیر جدید هم یک نفر روی ریل است. چه باید بکنید؟ هیچ کاری نکنید و بگذارید پنج نفر کشته شوند یا ریل عوض کنید و یک نفر کشته شود، کار درست چیست؟

این سوال از میلیونها نفر در سراسر دنیا پرسیده شده، بیشتر افراد میگویند باید قطار تغییر مسیر دهد.

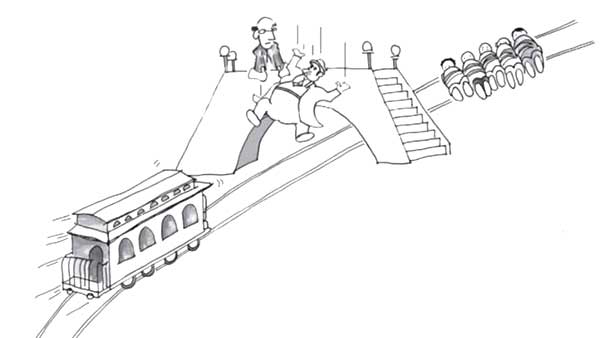

حالا شکل دیگر این مسئله را در نظر بگیرید. همان قطار ترمز بریده به سمت آن پنج نفر در حال حرکت است. شما بالای پلی ایستاده اید که قطار قبل از اینکه به آن پنج نفر برخورد کند باید از زیر آن رد شود. روی پل یک نفر هم با کولهپشتی عظیم خود ایستاده است. تنها راه نجات آن پنج نفر این است که مرد را با کوله پشتی بزرگش از بالای پل، روی ریل بیندازید تا باعث توقف قطار شود. دوباره مسئله بین جان پنج نفر و جان یک نفر است. اما در این مورد بیشتر مردم پاسخ میدهند که مرد کولهپشتیدار نباید کشته شود.

این معمایی است که دهها سال است مطرح است و هنوز فیلسوفان درباره آن اختلاف نظر دارند. فایده گرایان (Utilitarian) -که عقیده دارند ما برای رسیدن به نهایت خوشبختی یا سعادت باید دست به عمل بزنیم- فکر میکنند حس درونی ما در مورد مرد کولهپشتیدار اشتباه است. آن مرد باید قربانی شود و ما باید جان پنج نفر را نجات دهیم.

معماهایی مثل مسئله قطار بشدت غیر واقعی هستند، با این حال در آینده مواردی خواهند بود که خودروی بدون راننده باید تصمیم بگیرد و انتخاب کند به کدام طرف بپیچد و به چه کسی آسیب بزند یا چه کسی را در معرض خطر قرار دهد.

این پرسشها خود پرسشهای بسیاری در پی میآورند. چه برنامه اخلاقی باید به این خودروهای بدون راننده بدهیم؟ جان سرنشین خودرو را در قیاس با رهگذران و مسافران خودروهای دیگر چگونه باید ارزشگذاری کنیم؟ آیا حاضرید خودرویی بخرید که حاضر است جان سرنشین خود را برای نجات جان رهگذران به خطر بیندازد؟ اگر جوابتان بله است، شما غیرعادی هستید.

و بعد مسئله خطیر دیگری مطرح می شود که این تصمیم هایاخلاقی را چه کسی باید بگیرد. دولت باید تصمیم بگیرد که این خودروها چگونه تولید شوند؟ یا سازندگان خودرو؟ یا شاید خود شما به عنوان مصرف کننده؟ آیا میشود به نمایشگاه خودرو بروید و علاوه بر رنگ ماشین اصول اخلاقی آن را هم انتخاب کنید: “من میخواهم یک پورشه کروکی آبی فایدهگرا که یکی را میکشد تا پنج نفر را نجات دهد بخرم!”

ران ارکین وقتی به این موضوع علاقمند شد که در سال ۲۰۰۴ در کنفرانسی درباره اخلاق روباتی شرکت کرد. او به خاطر میآورد که یکی از حاضران این بحث را پیش کشیده بود که چه گلولهای برای کشتن افراد بهتر است، بزرگ و کند یا کوچک و سریع. این ارکین را به این فکر انداخت که باید انتخاب کند: “آیا باید پا پیش بگذاریم و مسئولیت تکنولوژیای را که خلق می کنیم به عهده بگیریم یا نه.” از آن زمان به بعد او خود را وقف اخلاق روبات-اسلحههای خودکار کرده که به روباتهای قاتل معروف شدهاند.

برخی خواستار ممنوعیت روبات-اسلحههای خودکار شدهاند، اما ارکین رویکرد دیگری را در پیش گرفته است: “اگر ما بتوانیم روباتی بسازیم که از مرگ شهروندان جلوگیری کند باید این کار بکنیم.”

“من طرفدار جنگ نیستم. اما اگر ما هنوز اینقدر احمقیم که خودمان را بکشیم، به نظر من باید از بیگناهان در میدان نبرد محافظت کنیم.”

روبات-اسلحه های خودکار مثل خودروهای بدون راننده موضوع داستان های علمی تخیلی نیستند. سلاحهایی که کنترل آنها کاملا در اختیار انسان نیست همین الان وجود دارند مثل موشکهایی که در صورت مواجه با پدافند تغییر جهت میدهند.

در رویکرد ارکین باید به روباتها برنامهای شبیه به مقررات جنگی کنوانسیون ژنو بدهیم و مثلا مانع از کشتن عمدی غیر نظامیان شویم.

اما همین موضوع پیچیدگی وحشتناکی دارد، روبات باید بین شهروند دشمن که با چاقو می جنگد و جراحی که برای نجات مجروحان چاقو در دست دارد تمایز قائل شود.

راه دیگر بررسی مشکلات این چنینی چیزی است که به آن “یادگیری ماشین” میگویند.

سوزان اندرسون فیلسوف و مایکل اندرسون دانشمند علوم کامپیوتر است. آنها زن و شوهرند و همکار. آنها معتقدند که بهترین راه یاد دادن اخلاق به روباتها این است که ابتدا برخی اصول مشخص را در آنها برنامهریزی کنیم: “پرهیز از درد و رنج، نشر شادی” و بعد به ماشین اجازه بدهیم تا از مواجهه با سناریوهای مختلف یاد بگیرد که چگونه این اصول را در شرایط متفاوت به کار گیرد.

به عنوان مثال روبات-پرستارها را در نظر بگیرید که برای کمک به بیماران و سالمندان طراحی شدهاند، روباتی که برای آنها کتاب یا غذا میآورد، چراغها یا تلویزیون را خاموش میکند. انتظار میرود در دهه آینده صنعت تولید روبات-پرستار شکوفا شود. روبات-پرستارها هم مثل خودروهای بدون راننده و روباتهای قاتل باید گاهی تصمیم بگیرند. فرض کنید بیماری حاضر به خوردن دارویش نباشد، شاید تا چند ساعت این مسئلهای نباشد چون حق بیمار در تصمیم گیری آزاد ارزشی است که ما به آن احترام میگذاریم. اما وقتی هم هست که باید به بیمار کمک کرد چون ممکن است جانش در خطر باشد.

سوزان و مایکل فکر میکنند وقتی روباتها یک سلسله از این مسائل را با استفاده از همان اصول پایه پردازش کنند، برایشان روشنتر میشود که چگونه باید عمل کنند. حتی آدمها هم میتوانند از آنها یاد بگیرند. سوزان میگوید: “من فکر میکنم روباتها از یک فرد معمولی تصمیمهای اخلاقی درستتری خواهند گرفت”. نه سوزان نه مایکل از فکر اینکه یک روبات-پرستار از آنها مراقبت کند معذب نیستند. مایکل میگوید اینکه روبات زیر آدم را تمیز کند بمراتب بهتر از شرمندگی این است که یک آدم این کار را بکند.

اما “یادگیری ماشین” هم مشکلات خاص خود را دارد. اول اینکه ماشین ممکن است درس را به اشتباه یاد بگیرد. مثلا معلوم شده ماشینهایی که با تقلید از آدمها زبان یاد، میگیرند پیش داوریهایی را هم یاد میگیرند. اسامی مردها و زنها با چیزهای مختلفی مرتبط هستند و ممکن است ماشین به این باور اشتباه برسد که جک یا فرد برای دانشمند شدن مناسبتر از جوآنا یا فیونا است. ما باید به این سوگیریهای خطا آگاه باشیم و سعی کنیم که با آنها مقابله کنیم.

اما مسئله اساسیتر این است که در سیر یادگیری ممکن است نتوانیم پیشبینی کنیم که روبات در آینده چگونه رفتار میکند، ما ممکن است حتی بدرستی نفهمیم که روبات چگونه تصمیم گرفته است. این احتمال نگران کننده است، بخصوص اگر قرار باشد روباتها تصمیمهای حیاتی زندگی ما را بگیرند. یک راه حل نسبی این است که اگر وضعیت بدی پیش بیاید، بتوانیم این اصول را بازبینی کنیم- در واقع بدقت آنچه را اتفاق افتاده بررسی کنیم. اینکه روبات را مسئول اعمالش بدانیم، هم احمقانه است و هم به درد نمیخورد.- مثلا مجازات کردن روبات چه فایدهای دارد؟ قضاوت بعدی این است که چه کسی اخلاقا و قانونا مسئول اعمال بد یک روبات است.

یکی از مزایای روباتها این است که یکدست عمل میکنند. آنها در شرایط مشابه یک کار را انجام میدهند. روبات-سلاحهای خودکار در اثر عصبانیت تصمیم غلط نمیگیرند. در دنیا سالانه بیش از یک میلیون نفر در تصادف رانندگی میمیرند که علت اکثر آنها خطای انسان است. کاهش این آمار جایزه بزرگی است.

البته این که ما برای یکدستی و یکنواختی ارزش قائل هستیم هم موضوع جالبی است. اگر روباتهای قاضی همیشه از جملات یکسانی برای محکوم کردن مجرمان استفاده کنند، دلیل محکمی است که صدور حکم را به آنها بسپاریم. اما با حذف تماس انسانی قاضی و مجرم، چیزی در این بین از دست نمیرود؟ پروفسور جان تاسیولاس، استاد کینگز کالج لندن، معتقد است که این ارتباطات در هم و برهم انسانی ارزش دارند: “آیا میخواهیم نظام جزایی ما به تضادهای ارزشی دردناکی که در پروندههای قضایی وجود دارد پاسخی مکانیکی و یک دست و یک شکل بدهد؟ وقتی درستکاری فردی و مسئولیت را از تصمیمگیری انسانی حذف کنیم چیزی واقعا مهم را از دست ندادهایم؟”

ایمی ریمر درباره آینده خودروهای بدون راننده هیجانزده است. فقط این نیست که جان آدمها حفظ میشود، ترافیک و آلودگی کم میشود و یکی از معدود چیزهایی خواهد بود که خرید آن برای شما وقت به همراه می آورد. در مسئله قطار این خودروهای بدون راننده چه خواهند کرد؟ با دو کودک تصادف میکنند یا به طرف دوچرخه میپیچند؟ جگوار لندرور هنوز این پرسش را بررسی نکرده، اما ایمی در اینکه این موضوع اهمیت داشته باشد تردید دارد: “من برای گرفتن گواهینامه رانندگی به چنین سوالی جواب ندادم و الان هم اجازه دارم رانندگی کنم. چرا باید حکم کنیم که خودرو باید برای این سناریوهای نامحتمل جواب داشته باشد پیش از اینکه به خودمان اجازه بدهیم از منافع آن بهرهمند شویم.”

این سوال بسیار خوبی است. اگر خودروهای بدون راننده از کشته شدن انسان ها جلوگیری میکند، چرا نباید آنها را در خیابانها بکار بگیریم و بعد این مسئله را حل کنیم که در مواقع نادر این خودروها چه باید بکنند. البته در نهایت بهتر است امیدوار باشیم که روباتها اخلاقی برنامهریزی شوند- به دلیل اینکه خواه ناخواه در آینده هرچه بیشتر تصمیمهایی را که انسانها میگیرند روباتها خواهند گرفت.

و البته دلایلی برای نگرانی وجود دارد. ممکن است کاملا نفهمیم که چرا روبات یک تصمیم بخصوص را گرفته است. لازم است که مطمئن باشیم روباتها پیشداوریهای ما را دریافت و تشدید نمیکنند. اما یک قابلیت مثبت هم وجود دارد. ممکن است معلوم شود روباتها در برخی تصمیمهای اخلاقی از ما انسانها بهترند. شاید همین ما را انسانهای بهتری کند.

نظر شما چیست؟

پرسش های خود را در بخش پرسش و پاسخ مطرح کنید